ブログ

HOME Developer Square ブログ オープンソースのCloud CustodianとFalcoを使用して、24のGoogle Cloud Platform(GCP)セキュリティベストプラクティスを満たす方法

オープンソースのCloud CustodianとFalcoを使用して、24のGoogle Cloud Platform(GCP)セキュリティベストプラクティスを満たす方法

Google Cloud Platform (GCP) を利用して解決策を構築する際、運用性、安全性、信頼性、パフォーマンス、コスト効率など多くの要素を考慮し、設計の初期段階からこれらを組み込むことが重要です。

GCPでは、サービスに応じてユーザーとクラウド事業者の責任が変わり、共通のセキュリティ責任を共有します。

セキュリティのベストプラクティスには、企業アカウントの使用、多要素認証の有効化、IAMポリシーの適切な設定などが含まれます。

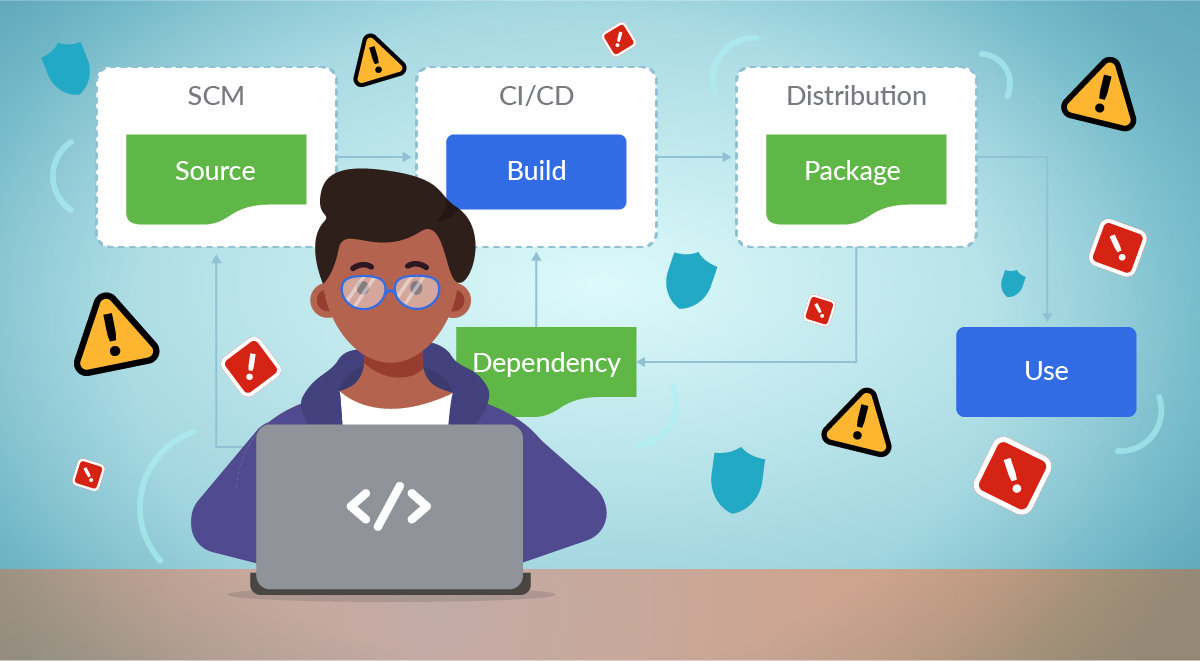

また、Cloud Identityを使用してアクセスとコントロールを管理し、Cloud CustodianやFalcoなどのツールを活用してセキュリティを強化します。

GCPのセキュリティベストプラクティスを遵守し、コンプライアンス標準に従うことで、クラウド環境を安全に保つことが可能です。