工場の「デジタルツイン」で働き方を変える。トヨタ自動車が目指す魅力的な職場づくり

- 導入事例

- メタバース

- デジタルツイン

- ../../../article/2024/02/tmc_omniverse.html

こんにちは、ITPNAVIの加藤です。世界が注目する大企業NVIDIA社が主催するカンファレンス「NVIDIA GTC 2024」。今回、アメリカで開催されたこちらのイベントに参加して参りました。 本レポートでは、CEOのジェンスン・フアンによるKeynote(基調講演)の内容を分かりやすく、現地の盛り上がりとともにお伝えします。

【この記事を書いた人】ITPNAVI編集部 加藤優子

ITPNAVI編集部の加藤です!

連載「カトウタイムズ」でさまざまなIT関連の最新情報を、

SCSK社員である私の視点で皆様にお届けしています。

目次

NVIDIA GTC 2024のGTCとは、GPU Technology Conferenceの略称で、NVIDA社が主催する年に一度のカンファレンスを指します。AIアプリケーションおよびソフトウェア開発者向けの技術的なカンファレンスとなっており、NVIDIA社内外のビジネスリーダーや専門家、開発者による講演や、企業によるブース展示などがあります。

(NVIDIA社およびGPUの概要はこちら)

コロナ禍により2020年からはオンライン開催となっていましたが、今年はカリフォルニア州サンノゼのコンベンションセンターにて、5年ぶりにリアル開催されました。2024年3月18日(月)~21日(木)(米国時間)の会期中は、900を超えるセッションと約300社のブース展示がありました。

オンラインを含めた申込者は30万人を超え、現地にも過去最高となる2万人以上が訪れたそうで、町中がAIおよびGPUの最新テクノロジーに沸きました。ちなみに、筆者はアメリカ入国時の税関手続きにて、「ここには何の目的で来たの?」ではなく、「あなたもGTC?」と聞かれました。また会場となったサンノゼにつながる大通りには、長距離にわたってずらっと垂れ幕がかかっており、それだけの大イベントであることが伺えました。

サンノゼ コンベンションセンターの正面

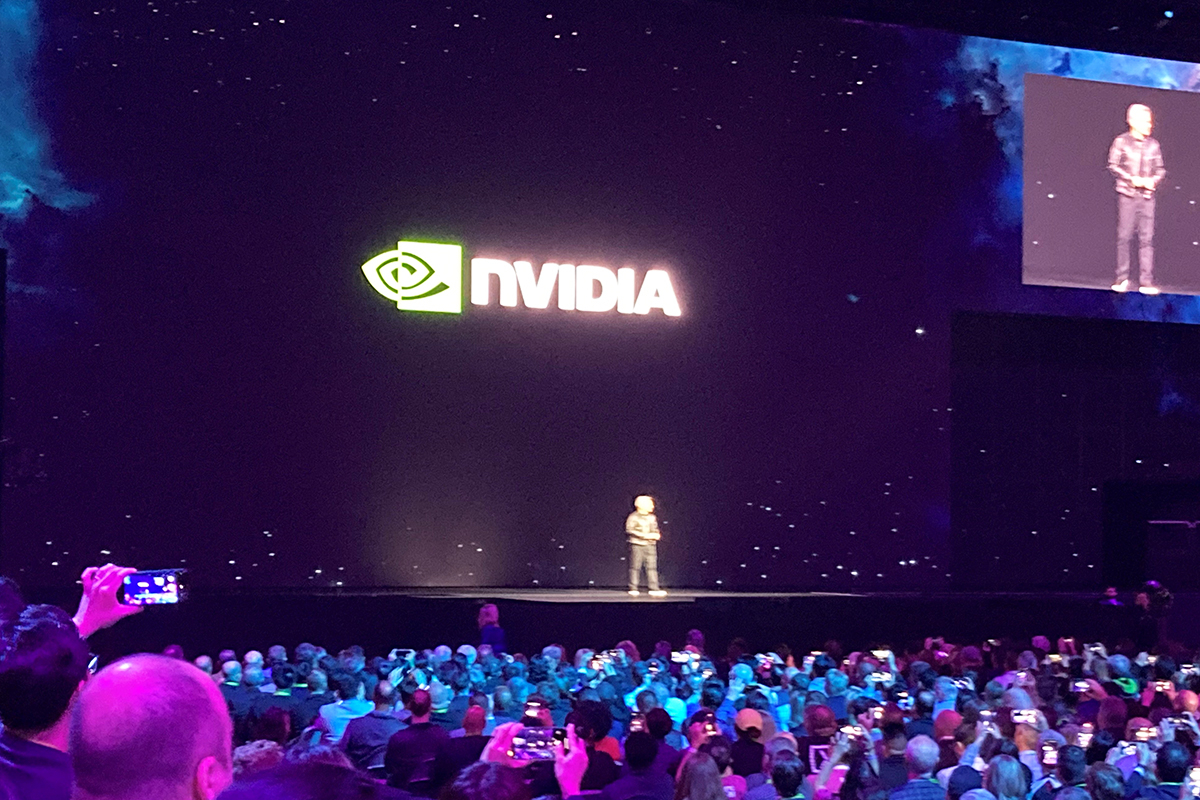

GTCの一番の目玉は、NVIDIA社の創設者にしてCEOであるジェンスン・フアンのKeynote(基調講演)です。基調講演ではNVIDIA社の最新のソリューションや開発ロードマップが発表されるため、世界中が注目しています。

今年の基調講演は会期初日の3月18日(月)13時(米国時間)からの発表となりました。凄まじい数の来場者が予想されたことから、会場はサンノゼ コンベンションセンターではなく、そこからシャトルバスで10分ほど移動したSAPセンターで行われました。

SAPセンターの正面には大きく「GTC」の文字が

次から次へとシャトルバスが到着し、会場周辺はあっという間に人で埋め尽くされました。入口が何か所かに分かれていたためあらゆる場所に行列ができ、果たしてこの列で正しいのだろうか?と不安になりながら開場を待ちます。

11時前。いよいよ開場し、筆者は無事ステージ左手のアリーナ席をゲットすることができました。用意された1万1000人分の座席はあっという間に埋まり、12時頃には満員で入れなかったそうです。

待ち時間も退屈しない、感動するほどのリアルなグラフィックス

開始時間まではステージ上の8Kスクリーンに幻想的な画像が映し出されていました。あまりの鮮明さと綺麗さに、スクリーンの奥には空間が広がっていて、実際に何かが飛び出してきているのではないかと思ったほどです。ここにもGPUの性能が存分に生かされているのを感じました。

登場した直後のジェンスン・フアン

13時。登場したジェンスン・フアンを歓声と拍手で迎えます。そんな会場を見たジェンスン・フアンが「これはコンサートではありませんよ」とジョークを言っていましたが、さながら大物ミュージシャンのコンサートと思えるほどの規模と盛り上がりでした。

冒頭ではGPUコンピューティングおよびAIの歴史を振り返りつつ、いよいよNVIDIA社の最新ソリューションが発表されます。

ここからは、今回の基調講演の内容について、実際に現地で得られた内容をもとに、わかりやすく解説したいと思います。

まず、基調講演の中でジェンスン・フアンが最も強調していたキーワードが「生成AI(※)」です。生成AIは従来のAIと異なり、それ自身が全く新しいアプリケーションおよびソフトウェアを生み出す力があるという点で、あらゆる企業のビジネスプロセスを改革する一大産業になると述べました。そしてNVIDIA社は、この生成AIを使って、企業の業務効率化とアプリケーション開発を促進するために、大きく3つのソリューションを打ち出しました。それぞれ、Blackwellプラットフォーム、NIM、Omniverseによるデジタルツインです。

※生成AI(別名ジェネレーティブAI)とは、画像、文章、動画、音声といったコンテンツを自ら作成できるAIのことです。従来のAIは事前に与えられた学習データの中から適切な情報(回答)を抽出するのに対して、生成AIは新しい情報を生成できるという違いがあります。生成AIを活用した代表的なサービスとしてはChatGPTがあり、まるで人間のような自然な文章を自ら作成してチャットベースで会話できます。

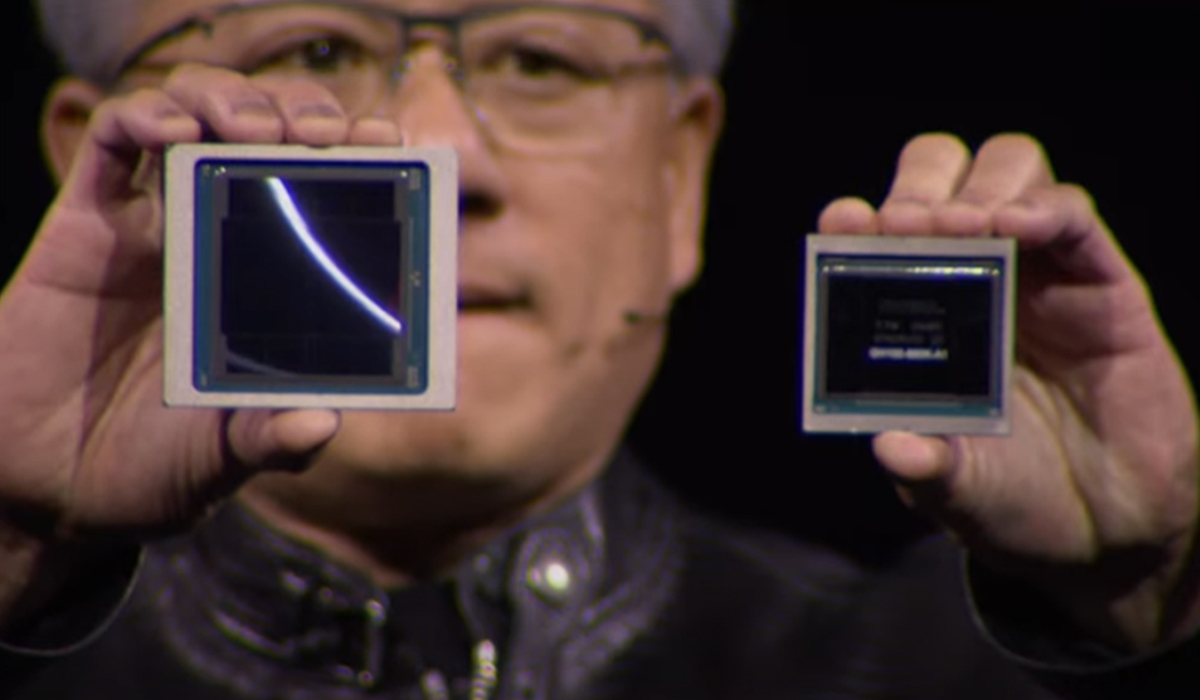

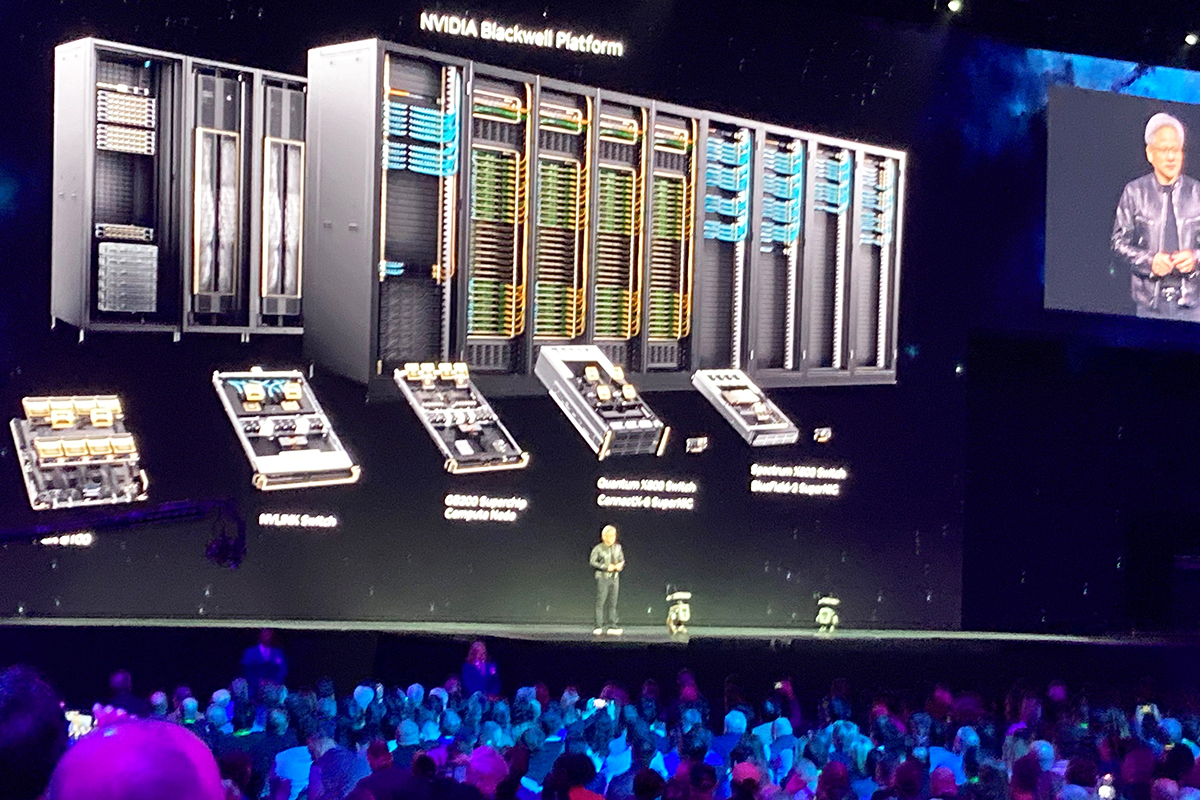

Blackwellの紹介するジェンスン・フアン(出典:NVIDIA)

Blackwellとは、NVIDIA社が2021年に発表した「NVIDIA Hopper」の後継となる、最新のGPUアーキテクチャです。このアーキテクチャのもと、生成AIの利用・開発を促進するために、以下のモデルをはじめとするBlackwellプラットフォームが発表されました。

Blackwellをベースに開発された最新のGPUです。2枚の半導体チップを集積することで、Hopper比で2倍以上となる2080億個ものトランジスタを有し、AIの計算処理能力を向上します。

2つのB200 GPUを、同じくNVIDIA社が開発したGrace CPUと接続したスーパーチップです。AI推論においてはHopper比で30倍高速に、そして電力効率が25倍になり、AI利用を加速するとともに、エネルギー消費も抑えます。

最大で数万個のGB200のスーパーチップを搭載したAI向けスーパーコンピュータです。大規模な生成AIのトレーニングおよび推論に対応できるよう、常時1兆パラメータものモデルを処理します。

(出典:NVIDIA)

NIM(NVIDIA Inference Microservice)とは、生成AIアプリケーションを開発するためのマイクロサービスです。具体的には、アクセラレーテッドコンピューティングライブラリ(CPUとGPUのリソースを効率よく活用することで、コンピュータの処理性能を最大限に高める手法:詳しくはこちら)と生成AIモデルから構成されます。

生成AIアプリケーションを開発するためには、実現したい機能に応じた適切な生成AIモデルと、それを高速に処理するコンピューティング技術が必要です。NIMでは、それらをセットにして最適化した状態で提供しています。例えばChatGPTにも使われているLLM(大規模言語モデル)もNIMの一つとしてラインナップしており、企業はそれをインストールするだけで、高精度かつ高速な自然言語処理の生成AIアプリケーションを開発できます。

同じくNIMの一つとして提供される「NeMo」も注目されています。というのもNeMoは、マルチモーダルな生成AIモデルに対応しているからです。

従来の生成AIは、学習モデルと同じ単一モーダル(データの種類・形態)の回答しかできませんでした。つまり、文章を学習した生成AIは文章しか生成できず、画像を学習した生成AIは画像しか生成できない、ということです。一方マルチモーダル生成AIとは、複数のモーダルを学習し、データを生成することができます。例えば最新のChatGPT(GPT-4V)がそれにあたります。従来のテキスト入力だけでなく、音声や画像を入力し、ChatGPTからさまざまな回答を得ることが可能です。

マルチモーダル生成AIは多才な分、それだけ多くのデータ処理と複雑な統合、アーキテクチャの設計が必要となり、一から開発するのは非常に労力がかかります。NeMoによってそれらがマイクロサービスとしてすぐに利用できるため、企業において利活用が促進されることが期待されます。

ちなみにNIMはNVIDIA社のGPUが搭載されたプラットフォームで利用できます。NVIDIA DGX Cloudはもちろん、AWSやAzureからでもアクセスできます。

(出典:NVIDIA)

「NVIDIA Omniverse」はデジタルツインを構築するためのプラットフォームです。あらゆる3Dデータを取り込み、現実と見間違うほどのリアルなビジュアライゼーションとシミュレーションによって、現実世界の現象をデジタルで再現できます。このOmniverseに、ロボット開発に特化したいくつかのモジュールが追加されました。

Omniverseについて詳しく知りたい方は以下の記事もご覧ください。

Omniverseでできることが知りたい方向け:セミナーアフターレポート

トヨタ自動車が取り組むOmniverseを使ったデジタルツインの事例

「Isaac Perceptor」は、自律移動ロボット(AMR)が周囲の状況をより良く認識し、複雑な環境にも対応できるようなプログラムを開発するキットです。

Isaac Perceptorが組み込まれたOmniverse上のデジタルロボットは、マルチカメラによって3Dで周囲の環境を認識し、深度知覚によって自分の位置を正確に推定します。その結果、例えば工場搬送ロボットが「急に積み荷が倒れてきた」といった想定外の事態をリアルタイムに検知しながら、自律的に最適な搬送路を進むといったことが可能になります。

「Isaac Manipulator」は、マニピュレータ(ロボットアーム)でさまざまな動作を実行するためのライブラリです。

従来のロボットアームは特定の作業しか実行できず、例えば部品が変わったり少しでも動作を変えたりしようとすると、その都度プログラミングし直す必要がありました。Isaac Manipulatorが持つパスプランニングおよびキネマティックライブラリを活用し、AIトレーニングを高速に行うことで、ロボットアームは周囲の状況を認識し、自律的に作業できるようになります。結果として再プログラミングの工数を大幅に削減するとともに、複雑な作業を実行できるようになります。

「Project GR00T(読み方:グルート)」は、ヒューマノイドロボット用(人型ロボット)の汎用基盤モデルです。「Jetson Thor」と呼ばれる専用のコンピュータと、生成AI基盤モデル、シミュレーションモジュールなどを含み、ヒューマノイドの開発を推進します。

GR00T を搭載したロボットは、人間の言葉を理解し行動を観察することで、自然な動きを模倣できます。その結果、人間と同じ器用さが求められるような作業スキルも迅速に学習します。そのプラットフォームはBlackwell アーキテクチャに基づいて設計されているため、膨大な計算量のモデルでも高速に実行することが可能です。

Omniverseでトレーニングされたロボットを連れて歩くジェンスン・フアン

ロボット以外のOmniverseに関する大きなアップデートとしては、「Apple Vision Pro」との連携が挙げられます。「身に着けるコンピュータ」とも呼ばれるApple Vision Proは、Appleが開発した、コンピュータを搭載したXRゴーグルです。この度の連携により、Omniverseで構築したデジタルツインをApple Vision Proを通してリアルに可視化し、操作できるようになりました。

インタラクティブかつ没入感のあるデジタルツインは、あらゆるビジネスプロセスを加速します。例えば自動車業界の設計プロセスにおいて、デザイナーが設計した車両を細部までレビューし、その場で色味やパーツを変更して感触を確かめる、といったイメージ動画が紹介されました。

(出典:NVIDIA)

2時間にわたる基調講演において、これら以外にも生成AIに関するさまざまなソリューションが発表されましたが、その度に大きな歓声と拍手が巻き起こり、会場全体が熱気に包まれていました。初めから終わりまで、全く目が離せない基調講演でした。

余談ですが、昨年の基調講演は2時間の予定を大幅に超過し、3時間近く続きました。今年は4時間かな?と冗談を言っていたところ予定通り終わって安心しつつ、もっと聞いていたかったと思ったのも事実です。

昨年までの基調講演では「メタバース」がキーワードだった一方、たった1年で生成AIに方針を移し、すでに開発モデルまで発表するこのスピード感。そして何より現場の熱狂。生成AIをハードウェア(GPU)とソフトウェア(NIMやOmniverse)で支えるNVIDIA社のますますの躍進をひしひしと感じました。

なお、基調講演のフルバージョンはYouTubeで公開されています。現地の盛り上がりをぜひ体感してみてください。:ご視聴はこちら

この記事では、NVIDIA GTC 2024の基調講演の様子と、ジェンスン・フアンが述べたNVIDIA社の最新ソリューションをお伝えしました。

※出典の無い画像は著者撮影

NVIDIA社の製品情報はこちら